はい、ごめんください。Microsoft Clarity(クラリティ)大好きコスギです。

この記事は Microsoft 社の公式記事「The Top 5 KPIs for an AI-Mediated Web」を和訳しつつ、私の考えなども入れたものです(和訳公開の許可を得ています)。ノイズなく読みたい方は以下からどうぞ。

以下に、要点を3行で。

- 従来のアクセス解析は検索が前提で、人が訪問してからの行動しか捉えられていなかった

- 現在は「AIが探し、読み、選んだあと」に人が訪問する構造へ変化している

- AI経由の流入・AI経由のCV・ボットの動き・AIによる引用・AIレコメンドといった新しいKPIが重要になる

AIを介したウェブサイトにおける主要な5つのKPI

アクセス解析に、奇妙な現象が見え始めています。

流入は横ばい、あるいは減少傾向。にもかかわらず、特定のソースからのコンバージョンは伸びている。「パフォーマンスが悪い」ように見えるコンテンツが、なぜか意思決定に影響を与え続けている。

このズレは、計測のバグではありません。ウェブの使われ方そのものが変わっているのです。

人々はもはや、検索結果やホームページから始めるとは限りません。AIツールや大規模言語モデル(LLM)から始めるケースが増えています。AIが読み、比較し、要約し、どの情報を伝える価値があるかを判断する、つまり、ユーザーがあなたのウェブサイトにたどり着く前から、AIがあなたの会社に対する認識を形作っているのです。

これは、アクセス解析にとって新たな課題を生み出します。

従来のKPIは、訪問中や訪問後の成果を測るには優れています。セッション数、直帰率、コンバージョンなどです。そしてオーガニック検索やリスティング広告など、ほとんどの流入チャネルは、インプレッションやクリックに関する詳細なデータを提供してくれます。それに対して、LLMはインプレッションやレコメンドに関するデータを一切提供しません。

AIを介したウェブサイトにおいて、サイト運営者や事業者が直面する最大の課題は、このブラックボックスの中で何が起きているかを理解し、それがビジネスの収益にどう影響しているかを定量化する方法を見つけることです。

この記事では、それを実現するための実践的なKPIを紹介します。今日からチームが計測できるシグナルから、より先を見据えた指標まで、AIがビジネスの「見つけられやすさ(discoverability:ディスカバラビリティ=発見性)」にどう関わっているかを理解するためにトラッキングすべき指標を探っていきます。

コスギ注

前回の記事は「AIにどう見られているか」でしたが、今回は「AIを通じてどうビジネスの成果につなげるか」という話ですね。

Microsoft がここまでAIの動きを可視化しようとしているのは、「今後、人の意志決定を左右するのがAIになるから、AIボットの動きを見ていくのは当然」という立場なんだと腑に落ちました。

ですから、GA4やサーチコンソールからわかることは「検索エンジンがオススメしてくれる示唆」であり、「AIがおすすめしてくれる示唆」として、Microsoft Clarity(の「AIの可視性」機能)を使えるようにしていきたいのでしょうね。

この考え方は今後のスタンダードになると思うので、Google もそのうち出してくるんだろうなあ……というのがホンネです。すでに、サチコで一部見れたような?夢?

それにしても横文字が多い世界ですが、「セッション」や「インプレッション」と同様に「レコメンド」も一般的になるのでしょうか……?

トラフィック→流入と訳せるにしても、レコメンド→紹介ってのは、やっぱり違和感しかなくて。しいていえば提案……は、サジェストですしね。トラッキング→追跡とするのもニュアンスがちょっと違うので、記事中ではそのまま使ってるんですが。悩ましい〜〜〜

1. AI経由の流入(AI Referral Traffic)

何を測るのか

AI経由の流入は、AIツール上のリンクをクリックして訪問者がサイトに来たセッションをトラッキングします。ChatGPT、Copilot、Gemini、Claude、Perplexity などからの流入であり、従来の検索・SNS・直接流入とは異なるものです。

なぜ重要なのか

AIツールが情報への主要な入口になるにつれ、発見のあり方そのものが変わりつつあります。生成AIツールがクエリ(特に情報収集系のクエリ)に答える最初のステップとなることで、従来の検索クリックは減少すると予測されています。

この環境では、単にページビューを測るだけでは不十分です。AIツールがいつ実際の人間の訪問者をサイトに送っているかを知る必要があります。AI経由の流入を把握することで、AIによる発見(見つけられやすさ)を可視化し、アクションにつなげられるようになります。

- あなたのコンテンツがAIの提案結果に表示されているか

- AI経由の訪問がどれくらいの頻度でサイトにアクセスしているか

- これらの訪問者が他のチャネルと比べてどう行動しているか

このシグナルは、AIがファネルに影響を与えている最初の実証的な兆候です。たとえ流入量がまだ少なくても。

トラッキング方法

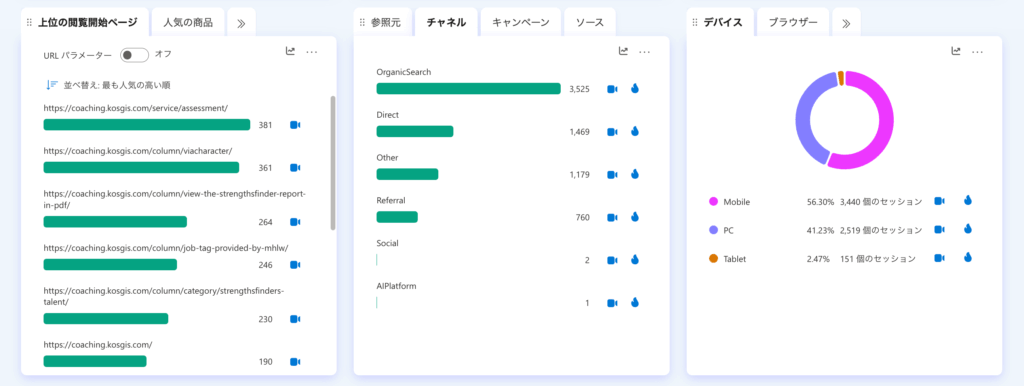

AIツールは参照元のリンクにUTMを付与するため、この指標の計測は非常に簡単です。多くのアナリティクスツールは、既存のチャネルレポートでこのチャネルからの流入をすでに計測できています。

Clarity は、AI経由の流入を2つの専用チャネルグループに分けることで、さらに詳細なレベルの情報を提供します。AI Platform(AIとの自然なやり取りからのアクセス)と Paid AI Platform(AIとのやり取り上に表示される広告からのアクセス)です。ChatGPT が広告を導入するという噂が広がる中、これは特に重要になってきています。

コスギ注

ChatGPTで表示されたURLをクリックすると、そのURLに「?utm_source=chatgpt.com」といったパラメータがついていることに気づいている人も多いのではないでしょうか(2025年5月以降のアプデによるもの)。こういったものが「AIPlatform」として計測されます。たまーに、ついていないこともあるんですけどね。

ですので、まず Clarity のチャネルで「AIPlatform」があれば、少なくともAIがあなたのサイトに言及している+相手が興味を持ってアクセスしていることがわかります。

問い合わせの理由に「AIにオススメされたので」と答える方も珍しくなくなってきていますから、ここが増えていくのはわかりやすい KPI になりうるとは思います。これからでしょうね。

ちなみに、Clarity は折れ線グラフのように時系列で追うようなビジュアライズが苦手なので、定期的に追いたければ GA4 + Looker Studio あたりでやるのがイイんじゃないかと。

2. AI経由のコンバージョン(AI Referral Conversions)

何を測るのか

AI経由のコンバージョンは、AI経由の訪問者がサイト上で意味のあるアクション(会員登録、デモ依頼、購読、購入など)を完了した頻度をトラッキングします。

AI経由の流入が「AIは訪問者を送ってくれているか?」に答えるのに対し、AI経由のコンバージョンはより重要な問い、「その訪問者は実際にビジネスに貢献しているか?」に答えます。

なぜ重要なのか

AIを介したウェブサイトでは、サイトへのアクセス数だけでは誤ったシグナルになります。AIはユーザーがサイトに到達する前に「事前選別」を行い、選択肢を要約し、絞り込み、特定の次のステップへ誘導することが多いのです。

その結果、AI経由の訪問者は以下の傾向があります。

- より明確な意図を持っている

- 意思決定プロセスのより先の段階にいる

- すぐに行動する準備ができている

AI経由のコンバージョンを測ることで、単なる好奇心のクリックではなく、この新しいチャネルをリード・売上・成果に直接結びつけられます。これは、AIからのアクセスを単なる「興味深い流入元」から「信頼できる成長の手がかり」に変えるKPIです。

懐疑的な見方も、ここで覆ります。AI経由の流入が全セッションの中で小さな割合であっても、コンバージョン率が高ければ、その重要性は再定義されます。訪問者数は少なくても、最も重要な指標でより高いコンバージョンを達成するチャネルは、量の多い流入元を上回る可能性があるのです。

トラッキング方法・概算方法

AI経由のコンバージョンは、AI経由の流入をセグメント化すれば、今日から完全に計測可能です。

実際には以下のように行います。

- AI Platform の流入でセッションをフィルタリング

- 検索・SNS・直接流入のチャネルとコンバージョン率を比較

- AI経由の訪問者がどの目標を最も多く達成しているかを評価

コスギ注

とはいえ「AIからの流入数が少なくてもCVRが高いならオッケー!」と盲目的に信じることはできません。分母が増えなければビジネスインパクトも小さいですからね。ウチみたいに30日で1件あって、それがCVしているなら100%ですが、そもそも n=1 でしかないわけですし。

ただし「AIに聞いた上でわざわざクリックしてきた人の “質” は高い」という仮説は直感的に納得しやすいので、今のうちにAI経由の流入を意識した施策は行っておきたいですよね。「すぐに成果につながるとは限らない」という可能性も視野に入れつつも、Clarity はユーザーIDで追えるので、AI流入の前後は(一応)確認できますし。

個人的に、AIが出した結果に表示される広告効果には懐疑的なんですが、リスティング広告の効果が認められている以上、過渡期はあっても馴染んでいくものなのかもしれません。

AIへの対応はロングテールSEOと同じようなものという考え方がしっくり来ているので、やることは結局、目新しいことではないかなとも思っています。むしろ、期待を裏切るほどに泥臭いでしょうね。

3. ボットおよびクローラーの活動(Bot and Crawler Activity)

ボットおよびクローラーの活動は、インデックス用ボット、AIクローラー、LLM がコンテンツにアクセスする頻度をトラッキングします。Copilot や ChatGPT を動かすような有用なボットと、それほど有用でないスクレイピングボット(ページの情報を自動収集するボット)の両方を含みます。人間のセッションに注目するのではなく、流入やコンバージョンが発生する前に、AIがあなたのコンテンツをどれだけ見ているかを示す指標です。

このタイプのサイト上の動きを監視することで、AI経由の流入やコンバージョンの背景にある「なぜ」を理解するための、ファネル上流のデータが得られます。

たとえば、AI経由の流入が少なく、増加していないとしましょう。ボットとクローラーの活動を分析すれば、根本的な問題を特定し、対処する手がかりが得られます。

クロールは多いのに流入が少ない場合:AIシステムはコンテンツを読んでいますが、流入できるようにはしていません。このパターンは多くの場合、関連性がない、あるいは明確さが足りないことを示しています。AIはあなたを見ているものの、回答を合成する際にあなたのコンテンツを「優先」していないのです。これはページのメッセージング、構造、またはセマンティックな明確さに問題がある可能性を示唆しています。

クロールが少ない場合:あなたのサイトは、そもそも推薦してくれるかもしれないシステムに見られていません。解決策は「見つけられやすさ(discoverability:ディスカバラビリティ=発見性)」の向上に集中することです。つまり、内部リンクの改善、スキーママークアップ、技術的な構造の整備、あるいはAIクローラーにページを訪問させるきっかけとなる外部シグナルの強化などです。

さらに一歩進めて、各LLMごとにクロール活動とAI経由の流入の関係を分析することもできます。

このプロセスは、SEOチームがクリックやコンバージョンを気にする前に、検索のインプレッション指標を使って表示の問題をトラブルシューティングするのと同じです。同様に、ボットとクローラーの活動は、流入やコンバージョンが発生するよりもっと前の段階で、AIからの見え方を診断するのに役立ちます。

トラッキング方法

ボットやクローラーの活動は、従来サーバーログ、CDN、ボット管理プラットフォームなどのインフラレベルのツールでしか確認できませんでした。これらはすべてのリクエストをキャプチャし、有益なAIエージェントと汎用ボットを区別できます。

現在では、行動分析ツールがこれらのシグナルをダッシュボードに直接統合し始めており、チームが単なるクロール量だけでなく、AIのインタラクションが人間の行動やコンバージョンとどう相関しているかを確認しやすくなっています。インフラデータと実用的なサイト分析の橋渡しが進んでいます。

Clarity はボットとAIクローラーのシグナルを直接アナリティクスに表示(和訳記事)するようになり、以下を区別できます。

- AIエージェント(既知のLLMインデックスやAIツールに関連するもの)

- 従来のボット(検索エンジンクローラー、スクレイパー、汎用の自動化)

- 人間の訪問者

これにより以下が可能になります。

- ボット活動全体のトレンドを時系列で測定

- ページごとのAIボットヒット数をセグメント化して、AIシステムがどこに時間を費やしているかを把握

- ボット活動とAI経由の流入トレンドを比較して、情報収集(ingestion)がどこで終わり、紹介(recommendation)が始まるかを確認

- クロール率が高いのに流入が少ないページを特定 → 典型的な診断パターン

コスギ注

「AI Bot Activity」の導入は Microsoft Clarity「AI Bot Activity」の使い方とサイト改善につなげる方法 にまとめておきました。

よく「AIに最適化するために構造化データ(FAQとか会社情報とか)を整備しよう!」とよく言われていますが、実はこれ「クロールはされるけれど流入にはつながりにくい」になりかねないんですよね。AIが回答を完結するから。

そもそも「クロールされていない」のなら、robots.txt などでブロックしているとか、コンテンツがロボットに読まれにくい(コンテンツすべてをJSレンダリングされるなどの)構造になっている可能性があります。こういうサイトは最初からSEOを想定していないことが多いので、AIに見つけられなくても問題ないですね。

この辺は、SEOのクロール → インデックス → ランキングと同じような考え方です。

4. AIによる引用(AI Citations)

- 実際の画面は公式記事の「AI Citations」のセクションをどうぞ。私は実際に使えるようになってから画面の説明をします。

何を測るのか

「AIによる引用」は、ユーザーがサイトにクリックして訪問しなくても、あなたのコンテンツをAIが生成する回答の中で使われたり、参照されたり、根拠として利用されたりしている状況をトラッキングします。人間による訪問を捉える「AI経由の流入」とは異なり、「AIによる引用」は上流での影響力を明らかにします。つまり、AIが回答、要約、レコメンドする際、その情報源としてあなたのコンテンツを使っていることを示してくれます。

なぜ重要なのか

ゼロクリックのAI体験が、「可視性(見つけられやすさ)」の定義を変えつつあります。あなたのコンテンツは、流入やクリック数といったアクセス解析の結果にまったく反映されないまま、ユーザーの問いに答えているかもしれません。AIによる引用の状況を知ることは、水面下で行われているやりとりを表面化させ、事業者やブランドが以下のことを可能にします。

- どのコンテンツがAIの回答に意味のある貢献をしているかを把握できる

- コンテンツがAIの情報源になっているのに出典元として明示されていない箇所を特定できる

- 競合がより多く認知を獲得しているトピックを検出できる

- 明確さ、構造、権威性を改善するための更新を優先できる

トラッキング方法

AIによる引用は、まだ新しい計測分野です。現時点では、ウェブ全体で統一された計測基準は存在していません。

多くのツールは、いくつかのプロンプトを用意し、AIに回答を生成させ、その出力にブランド名やURLが含まれるか、といった方法で引用を推定しています。これらの方法は傾向を把握する助けになりますが、AI内部で実際にどの情報が参照されたのかを直接観測しているわけではありません。あくまで「再現テスト」に近いアプローチです。

一方で、より構造的な方法も登場し始めています。AIの回答生成を支える「情報取得と根拠づけの仕組み(retrieval and grounding layer)」と連携し、実際の参照・引用の活動を集約して可視化する考え方です。

たとえば Clarity の新しいAIによる引用機能では、AIが生成した文章を後から解析するのではなく、Microsoft の情報検索基盤(retrieval layer)を通じて、あなたのコンテンツがどの程度参照・根拠として使われたかが表示されます。

コスギ注

ちょっと難しいセクションですね〜

「ゼロクリックのAI体験」とは

そもそも「ゼロクリック(Zero-click)」というのは、SEO用語です。「検索結果の一覧を見たら、特定のページをクリックしなくても、知りたかったことが解決できた状態」のこと。

これは、今に始まった話ではありません。たとえば「忖度 読み方」と検索すると、「忖度(そんたく)とは?」みたいなタイトルが並ぶわけです。ただ読み方を知りたいだけなら、「あ、そんたくって読むんだ」で解決して終わります。

現在は、そのあたりをAIが配慮して、「忖度」の読み方や意味も検索結果に表示してくれるんですよね。これが「ゼロクリックのAI体験(Zero-click AI experiences)」です。

AIを使う流れと本記事のポイント

ユーザーと生成AIとの流れを追うと、こんなふうに該当すると考えてみるといいかも?

- コレがすべてではなく、機能が関わるポイントとして。

- Grounding とRAGの違いとか全然わかっていないので、厳密に知りたい方は別途調べてください。

- ユーザーが質問(プロンプト)を入力する

- AIが関連情報を探す(Retrieval)← ボットおよびクローラーの活動・AIによる引用

- AIが情報を取り込む(Ingestion)← ボットおよびクローラーの活動

- AIが根拠として使う(Grounding)← AIによる引用

- AIが文章を生成する ← ここでレコメンドされる

- ユーザーが生成された文章を読む

- ユーザーが生成された文章内のリンクをクリックする ← AI経由の流入/CV

AIが何をやっているのかはまだまだブラックボックスなので、何が起きているのかを知れるのはこれからですね。こういうのは英語圏のほうが先でしょうが、AIにおける Google サーチコンソールみたいなものなので、どうなるか楽しみです。つまり、サチコにも入ってくるかも。

5. AIレコメンド(AI Recommendations)

現状:北極星(North Star)/将来に向けた指標

何を測るのか

AIレコメンドは、購買目的や意思決定系のプロンプトに対して、AIシステムがあなたの製品、サービス、ブランドをどのように提案しているかを定性的に測定するものです。

AIによる引用とは異なります。引用はあなたのコンテンツを情報源として出典元を明らかにすることです。しかしレコメンドは、それよりも深い意味を持ちます。つまり、AIがあなたの提供するものを「ソリューション」として位置づけているのです。

なぜ重要なのか

情報収集を目的とした従来の流入が、AIによる回答によってゼロクリックにますます移行する中、本当の戦略的価値は参照されること(知識提供=上流)から推薦されること(行動促進=下流)へと移行しています。

最も重要になるのは、AIシステムが以下を行うかどうかです。

- 比較の中であなたの製品を提案する

- 候補リストにあなたのサービスを含める

- 「○○に最適なツール」の回答であなたのブランドに言及する

- 購入検討シーンであなたのソリューションを推薦する

これが新たな戦場です。

もしAIがユーザーとウェブを仲介するなら、そのレコメンドに影響を与えることは、かつて検索で1位を取ることと同じくらい重要になります。AIレコメンドは、流入の測定から説得力の測定への転換を示しています。

現時点で把握する方法

今のところ、AIレコメンドを本格的に計測できる標準化されたウェブ解析ツールは存在しません。クロールデータや引用とは異なり、レコメンドされているかどうかを直接確認することは難しいためです。

しかし、私たちは以下の方法で疑似的に把握する方法があります。

- 購入される文脈を整理する(例:「中小企業向けの最適なCRM」「Xの代わりに使える安いツール」など)

- 主要なAIツールで、比較や意思決定段階のプロンプトをテストする

- 自社のブランドが表示されるか、どのように説明されるか、競合がどう位置づけられているかを観察する

- コンテンツ、SEOの順位、権威性の進化に伴う変化を時系列でモニタリング

AIレコメンドは、AIを介したウェブサイトにおけるウェブ解析の最先端領域です。丁寧な定性調査によって、ビジネスに関わる意図に対してAIがどう影響しているかを理解し、知見を広げていくことも可能です。

その気づきを数字で測れて改善に使える指標に変えることが、これからの分析の新しい領域になります。ユーザーへの影響は、クリックする前、ページを見る前、アクセス解析ツールに記録される前に、すでに起きていますから。

コスギ注

ここは、「AIレコメンドを解析する機能」よりも「AIにレコメンド(オススメ)されるとはどういう意味を持つか、そのために何ができるのか」という話です。そもそも、そんな機能がまだないので。とはいえ Clarity はここも目指していきたいという思いを感じますね。だから “北極星としての将来的な指標” です。

ということでポイントは以下。

- 「AIに推薦される」ことは「信頼できる知人からの紹介」に近くなるので、検索1位よりも強い購買シグナルになりうる

- 中小企業にとっては、自社がAIにどう説明されているかを把握することが第一歩

- 実際に ChatGPT などに「(自社の業種)に最適なサービスは?」などと聞いて、どんな結果が返るか試してみよう

「人に価値を届けられているか」が問われる時代ですね。

参考:AIにオススメされるかどうか、現時点でできること

AIレコメンドの、現時点で把握する方法の具体例です。

ただこれ、自分の使っている生成AIだと情報が偏りかねないので、ログアウトして使ったり利害関係のない相手に確認してもらうと、より精度の高い回答が出てきますよ。

① お客さんがAIに聞きそうな質問をリストアップする

「自社を知らないお客さんが抱えている悩みや比較の言葉」で考えるのがポイント。それぞれは自社のサービスなどに変えてくださいね。

- 課題起点

「小規模オフィスの防音対策、何から始めればいい?」「従業員5人の会社で使える勤怠管理の方法は?」 - 比較・検討

「税理士に頼むのと会計ソフトで自分でやるの、どっちがいい?」「○○と△△のサービスの違いは?」 - 地域+ニーズ

「○○市で相続の相談ができるところは?」「○○駅周辺でランチ会議に使える場所は?」 - 条件指定

「月額1万円以下で使える○○ツールは?」「初心者でもできる○○の方法は?」 - 不安・懸念

「○○を導入して失敗するケースは?」「○○のデメリットは?」

- 過去の問い合わせメールや電話の内容を見返すと、お客さんが実際に使う言葉が見つかりやすいかも。

- 営業担当に「最近よく聞かれることは?」と聞くのも有効です。

- 自社サイトのFAQやお客様の声に書いてあることは、そのままAIへの質問になりやすいですね。

- 最初から完璧なリストを作ろうとせず、思いついたものからでOK。やりながら増やせばいいんです。

② 複数のAIに実際に聞いてみる

リストアップした質問を実際に聞いてみます。同じ質問でもAIごとに回答の傾向がかなり違うので、お客さんが使っていそうなAIを想定して2個以上は試してみてください。

- ChatGPT

知名度の高いサービスを挙げやすい。具体的な社名・サービス名を出す傾向 - Gemini

Google 検索の結果を参照しやすく、SEOが強いサイトが反映されやすい - Copilot(Bing)

出典リンク付きで回答するため、ウェブ上に情報があるかどうかが直接影響する - Claude

慎重で、根拠が弱いと「一般論」に留まる傾向。逆に言えば、推薦されたら信頼度は高い - Perplexity

検索結果をベースに回答するため、最新の情報が反映されやすい

- 「○○(自社サービス名)って知ってる?」「○○についてどう思う?」と直接聞いてみるのもよいかも。まったく知られていないのか、情報はあるが推薦に至らないのか、の切り分けに使えます。

- 日本語と英語で結果が変わることが多いです(そもそもの文脈が違うので)。日本語での情報発信が少ない分野は、海外の競合ばかり出てくるケースもあるかもしれません。

③ 結果を記録する

スプレッドシートにでも記録を残しておきましょう。これこそ、AIに記録させるのでも良いのですが。

- 質問した日付

- 使ったAIツール

- 質問文(そのまま)

- 自社名が出たか(Yes / No)

- 出た場合、どう紹介されていたか(正確か、古い情報か、間違いはないか)

- 競合としてどこが挙がったか(上位3つ程度)

- 気づいたこと(自由メモ)

- 「うちの名前はまったく出ない」→ そもそも自社サイトに十分な情報がないかも。

- 「名前は出るが説明が古い・間違っている」→ サイト上の情報を更新すれば改善する可能性があります。

- 「競合A社がどのAIでも挙がる」→ A社のサイトやコンテンツの出し方を参考にしてみましょう。

- 「地域名を入れると出やすくなる」→ 地域密着のコンテンツを強化するのが良いのかも。

④ 定期的に繰り返す

AIの回答は変化します。ただでさえ固定化しないのに、学習データの更新、アルゴリズムの変更、情報の更新によって変わるので、1回やって一喜一憂して終わりではなく、定点観測しましょう。SEOと同じですね。

- 重要な質問を3つ × 3回 × ChatGPT・Gemini でやってみるのが基本

- 月1回以上、同じ質問リストを同じAIに投げる

- 大きなサイト更新やコンテンツ追加をした後にも、臨時で確認してみると変化が見えやすい

- 結果の記録と改善アクションはセットで考えること(ただの好奇心対応にしない)

- サイトに情報を追加したことが、翌月のAI回答に反映されるか確認しましょう。

- 競合がどんどん挙がるようになったら、相手が何をしたのかを分析しましょう。

- 業界全体の認知がAI上でどう形成されているかのトレンドがわかります。

- 「何をしても変わらない」ことがわかるのも価値です。別のアプローチが必要ですね。

余談:受け身のままではいられない

「数年前までは、わざわざサイトにアクセスして内容を見て、それで判断していたんだよね」なんて振り返る時代が来るかもしれません。

そもそも「流入」は、その行動を前提にした概念ですもんね。今後、AIが意志決定に関わるのであれば、この概念そのものが変わるわけで、パラダイムシフトと言えるのでしょう。

一昔前は、「ホームページから問い合わせてもらえれば答える」のが一般的だったために、「お問い合わせの送信」がコンバージョンになっていたんですよね。これはまだ、知りたい情報がどのカテゴリにあるのかを人力検索していた時代でした。判断の負荷はそこそこありましたが、それが当たり前だったわけです。

今では、「問い合わせるためには、せめて興味を持ってもらわないとアカン」とさまざまな情報を公開するようになり、検索エンジンがどんどん進化して人の意思決定に介入するようになりました。SNSもアルゴリズムによってフィルターバブルがかかるので、自分の意思がなんなのか曖昧になってきた時代のようにも思います。余談ですが、自己分析とか昔からあったものの、SNSも相まって今ものすごく “流行っている” ように感じていたのですが、「選んでいるようで選ばされている」ことへの直感的な警鐘でもあるんですかね。考えすぎか。

人は1日に3万回以上も意志決定しているそうなので、意志決定コストをラクにしたいというのが本能だとしたら、このまま行けば、ほとんどの人はAIに頼るようになるのが当たり前になるでしょうねと。

テクニカルに考えたらSEOのロングテール×SNSの口コミのハイブリッドな感じもしますが、AIに選ばれるために特別なことをするのではなく、人に選ばれる理由を明確に言語化することが本質だと思うんですよね。

出すべき情報と出すべきではない情報のバランスを見極めながら、AIの向こうにいるお客さんに届けましょ。